Die meisten Unternehmen tragen einen Stack mit sich, der über Jahre gewachsen ist. Salesforce für Kunden, SAP für Aufträge, Power BI für das Reporting, dazwischen eine Reihe Hilfssysteme, die irgendwann hinzukamen. Jedes Stück trägt seine eigene Logik, jedes wurde für einen anderen Zweck gebaut. Dazwischen stehen Menschen, die Daten abgleichen, Exporte erstellen und die Brüche überbrücken. Das funktioniert, solange Personen verfügbar sind und der Markt Rückenwind liefert. Mit AI als arbeitendem Partner verändert sich diese Voraussetzung. Die Frage ist weniger, wie sich ein gewachsener Stack besser bedienen lässt, mehr, wie eine Architektur aussieht, die heute neu entsteht und dabei AI-Agents als Anwender mitdenkt.

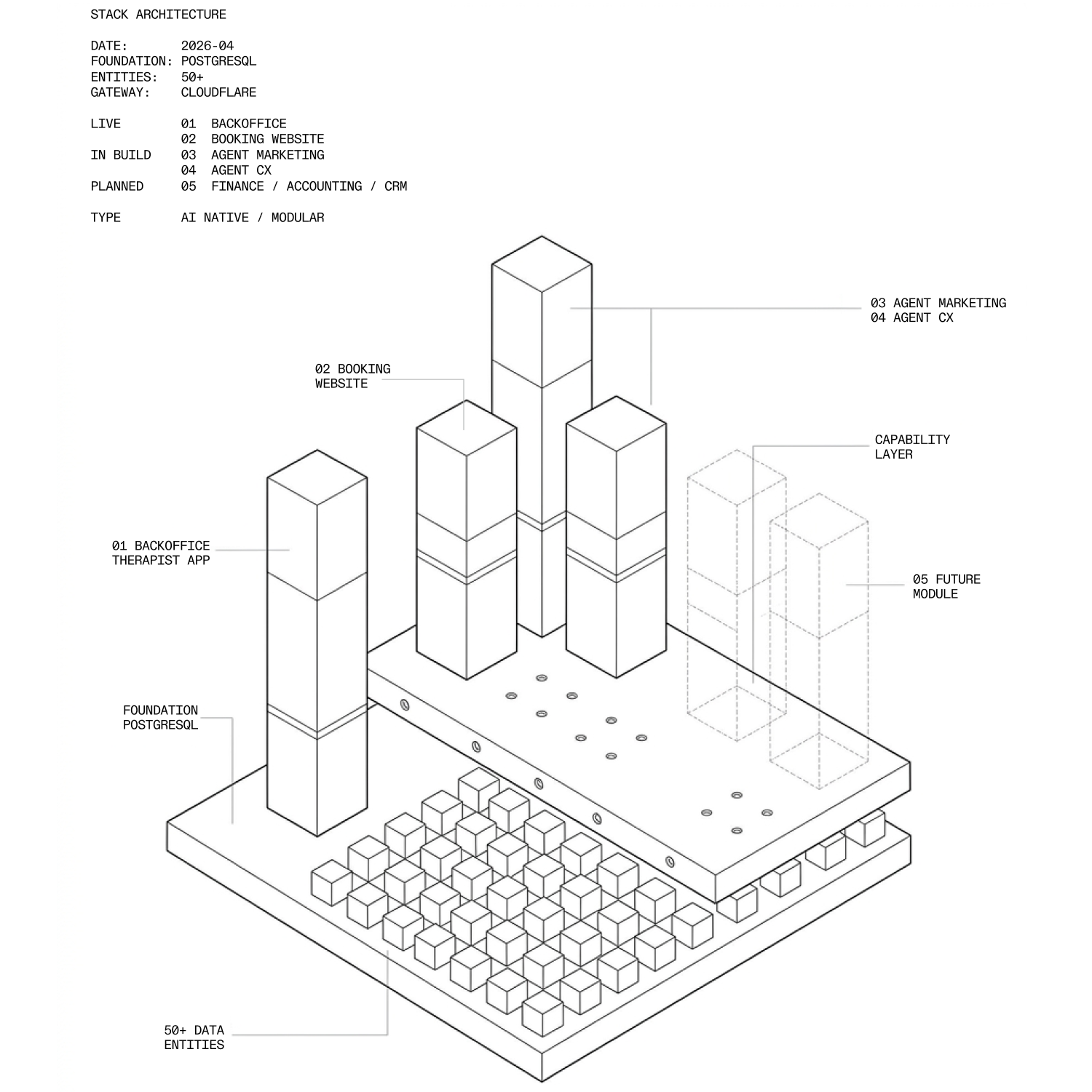

Eine Stack-Architektur, in der jede Schicht eine klare Aufgabe hat. Unten die Daten, ein Modell, das das Geschäft operativ abbildet, kein Universal-Schema von der Stange. In der Mitte ein Capability Layer, der die operativen Funktionen kapselt und nach oben über APIs verfügbar macht. Oben die Module, sowohl klassische Anwendungen als auch Agents, die auf dieselben Capabilities zugreifen. Modular genug, dass neue Module hinzukommen können, ohne dass die Foundation umgebaut werden muss.

Drei Schichten, ein Gateway. Die Foundation ist eine PostgreSQL bei AWS, mit rund 50 Tabellen, die das Foty-Geschäft operativ abbilden. Darüber sitzt der Capability Layer, der Funktionen wie Slot-Berechnung, Kollisionsprüfung, Buchungsanlage oder Kundenakte kapselt und über APIs zugänglich macht. Auf dieser Schicht arbeiten heute zwei Module live, die Therapeuten-App und die Buchungsseite, dazu zwei in Entwicklung, ein Agent für Marketing und ein Agent für Customer Experience. Weitere Module für Finance, Accounting und CRM sind geplant und werden hinzugesteckt, sobald der Use Case fragt. Cloudflare sitzt als Gateway davor und übernimmt CORS, Rate Limiting und das Routing zwischen den Modulen.

Auffällig ist weniger die Architektur selbst als das, was sie zulässt. Neue Module brauchen keine neue Foundation. Agents greifen auf dieselben Capabilities zu wie die menschlichen Anwendungen, eine doppelte Datenhaltung entfällt. Das Operating Model bleibt klein und vollständig zugleich, weil es genau dieses Geschäft abbildet und keinen Kompromiss aus tausend Branchen schließt. Die Beschleunigung beim Bauen kommt weniger aus dem Tippen, mehr aus dem Wegfall der Übergaben zwischen Rollen, weil Konzept, Architektur und Code im selben Gespräch entstehen. Tokenkosten für die Bauphase bis hierher: rund 600 Euro. Was vor zwei Jahren ein zwölfmonatiges Projekt mit mehreren Rollen gewesen wäre, ist heute eine Skizze, die schon trägt.